Per parą du DI flagmanai. Ką siūlo GPT-5.5 ir DeepSeek V4?

OpenAI pristatė naujos kartos didelį kalbos modelį — GPT-5.5. Praėjus kelioms valandoms, pasirodė ir DeepSeek V4 iš to paties pavadinimo Kinijos startuolio. Palyginkime deklaruojamas galimybes ir testų rezultatus.

GPT-5.5

Flagmaninis OpenAI modelis orientuotas į agentines užduotis: programavimą, darbą su dokumentais, kompiuterio valdymą. Tai reiškia, kad modelis pats planuoja veiksmus, naudoja įrankius ir užbaigia užduotį iki rezultato. Pasak kūrėjų, pažanga, palyginti su GPT-5.4, ypač pastebima ten, kur reikia ilgai išlaikyti kontekstą ir dirbti su įrankiais be nuolatinių vartotojo patikslinimų.

Kitas privalumas — efektyvesnis žetonų (tokenų) naudojimas. Nors GPT-5.5 yra brangesnis nei pirmtakas naudojant per API, atsakymų generavimui jam reikia mažiau resursų ir laiko.

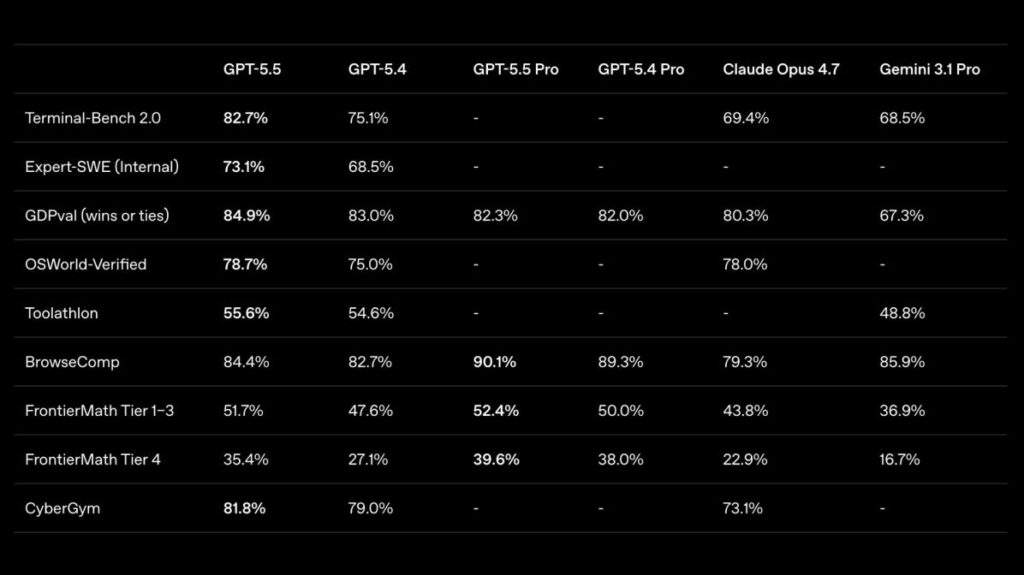

Teste Terminal-Bench 2.0, kuriame tikrinamas sudėtingų užduočių vykdymas komandų eilutėje su planavimu ir įrankių naudojimu, GPT-5.5 surinko 82,7 %. Tai 7 procentiniais punktais daugiau nei GPT-5.4 ir 11 punktų daugiau nei Claude Opus 4.7. Tačiau programavimo srityje modelis atsilieka nuo Anthropic sprendimo: SWE-Bench Pro (klaidų taisymas repozitorijose) rodo 58,6 %, kai tuo tarpu Anthropic modelis pasiekia 64,3 %. Graphwalks BFS 1M F1 teste, skirtame ilgo konteksto užduotims, matomas didelis šuolis — 45,4 % vietoje 9,4 %.

Tikslus parametrų skaičius ir konteksto ilgis neatskleidžiami, tačiau ateityje planuojama API prieiga iki 1 mln. tokenų konteksto.

ChatGPT ir programėlėse modelis prieinamas kaip GPT-5.5 Thinking ir GPT-5.5 Pro. Pirmasis skirtas Plus, Pro, Business ir Enterprise planams, antrasis — Pro, Business ir Enterprise. Modelis jau integruotas ir į Codex.

DeepSeek V4

Kinijos modelis, išgarsėjęs 2025 metų pradžioje, grįžta su nauju našumo lygiu. DeepSeek laikosi atvirojo kodo politikos, todėl modelį galima diegti savo įrangoje.

Siūlomos dvi versijos: DeepSeek-V4-Pro (mąstanti) ir DeepSeek-V4-Flash (greiti atsakymai). V4-Pro turi 1,6 trilijono parametrų, iš kurių aktyvūs 49 mlrd.; V4-Flash — 284 mlrd. parametrų ir 13 mlrd. aktyvių. Abi palaiko iki 1 mln. tokenų kontekstą.

Įdomi detalė — DeepSeek V4 optimizuota Huawei Ascend lustams, nes NVIDIA ir kitų Vakarų gamintojų sprendimai Kinijoje ribojami sankcijų.

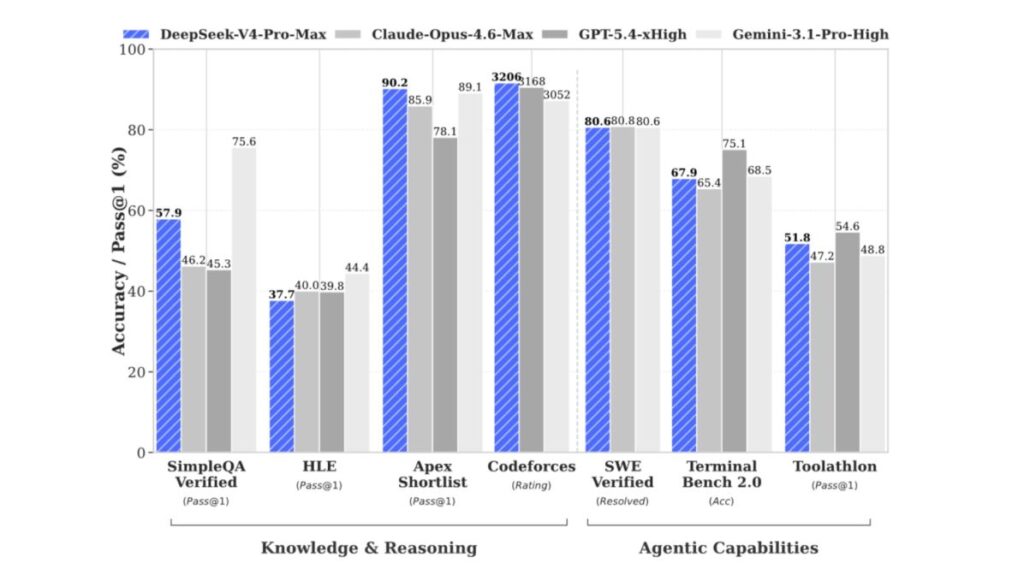

Pasak kūrėjų, V4-Pro-Max režimas (maksimalus samprotavimo režimas) yra vienas geriausių tarp atvirojo kodo modelių. SimpleQA-Verified teste — 57,9 %, GPQA Diamond — 90,1 %, HLE — 37,7 %, LiveCodeBench — 93,5 %. Tačiau agentinėse užduotyse modelis silpnesnis: SWE-Bench Pro — 55,4 %, Terminal-Bench 2.0 — 67,9 %.

Kūrėjai taip pat pabrėžia stiprius rezultatus dirbant su ilgu kontekstu: kai kuriuose akademiniuose testuose V4-Pro-Max lenkia Gemini 3.1 Pro.

DeepSeek išpopuliarėjo dėl prieinamumo: paslauga neriboja naudojimo, programėlės lengvai pasiekiamos, o mokama tik už API prieigą. Norint naudoti DeepSeek-V4-Flash, reikia įjungti „Greitą“ režimą, o V4-Pro — „Ekspertą“.